吴磊,2012年获南开大学学士学位,2018年获tyc234cc 太阳成集团博士学位。2018-2021年在普林斯顿大学应用与计算数学系从事博士后研究。2021年12月入职tyc234cc 太阳成集团信息与计算科学系,任助理教授。研究领域为深度学习的数学理论,特别侧重于随机梯度算法的隐式正则化和神经网络模型的逼近性质。

Q:请介绍一下您现在的研究工作?

A:一句话来说,我现在的工作是在尝试建立深度学习的理论基础。从Hinton 2012年关于ImageNet的工作以来,以神经网络模型为基础的深度学习方法在很多领域都取得了突破性的成功。然而我们对于深度学习的工作机制却几乎没有理解,这导致深度学习被大家戏称为“炼丹学”。我的工作目的是尝试用数学的语言和方法来理解神经网络的工作机制。这当然是一个很大的问题,我目前的研究主要集中在两个问题上。

第一个问题是:什么样的函数可以被神经网络所高效地逼近?我们知道传统模型在高维时都会有维数灾难的问题,而神经网络似乎没有。这是为什么呢?为此我们在尝试发展了一套适用于神经网络模型的高维函数空间理论。

第二个问题是:为什么随机梯度算法总能够收敛到那些泛化比较好的解?我们知道神经网络模型是非凸的、往往过参数化的,这导致系统存在大量全局极小值点。其中一些极小值点可能表现很差,因此大家自然会担心算法会收敛到那些差的解。然而实际中,简单的随机梯度法竟然总能收敛到那些好解。我的工作尝试从动力系统的稳定性角度出发来解释这个神奇的现象。

Q:在您的求学经历中,哪些因素或人促使您选择了目前的研究方向?

A:我的求学和科研经历比较简单,就是个想搞明白“为什么”的过程。我小时候就觉得数学很抽象,像方程、极限、求导等等,但是却能解决各种各样的问题,很神奇。我就非常想知道为什么,于是大学选择了数学专业。但是那个时候并不懂数学和数学的差别很大,就稀里糊涂地读了基础数学。后来发现自己并不特别喜欢基础数学,感觉太抽象了,缺少直观。这个时候,我开始对于编程产生兴趣。一次C++课上,有个同学给我展示了:如何写代码解决一个数学问题。我当时“大受震撼”,觉得很神奇,因为这些代码对于当时的我来说就是一堆字符而已。我想不通计算机是怎么通过这些字符串解决问题的,就想搞明白为什么,于是花了大量的时间学习编程和计算机的知识。

大三的时候参加北大的保研,当时就决定转到应用数学专业。基于我的编程基础,我自然地选择了计算数学专业。来了北大之后,就一直上上课、看看书,大部分时候都在自己探索,什么搞不明白就去看什么。特别地,我在鄂维南老师的建议下读了很多物理方面的书籍。虽然我博士前几年一直没有真正地开始科研,但是这几年的积累为我后来研究打下了扎实的基础。

后来跟着鄂维南老师做了个用tight frame框架来理解卷积神经网络的课题。虽然没有做出什么成果,但是我也算正是入门科研了。也因此读了一些深度学习方面的文章,发现深度学习方法效果特别好。我就特别想搞明白为什么,于是在鄂老师的指导下,开始了这方面的研究工作。

Q:为什么会选择回到北大数院工作?这里最吸引您的是什么?

A:我博士六年都是在北大度过的,对北大特别是数学学院已经非常熟悉了。北大数学一直都是国内最顶尖的存在,在这有最优秀的同事以及学生。我觉得这些对于研究来说是极其重要的。

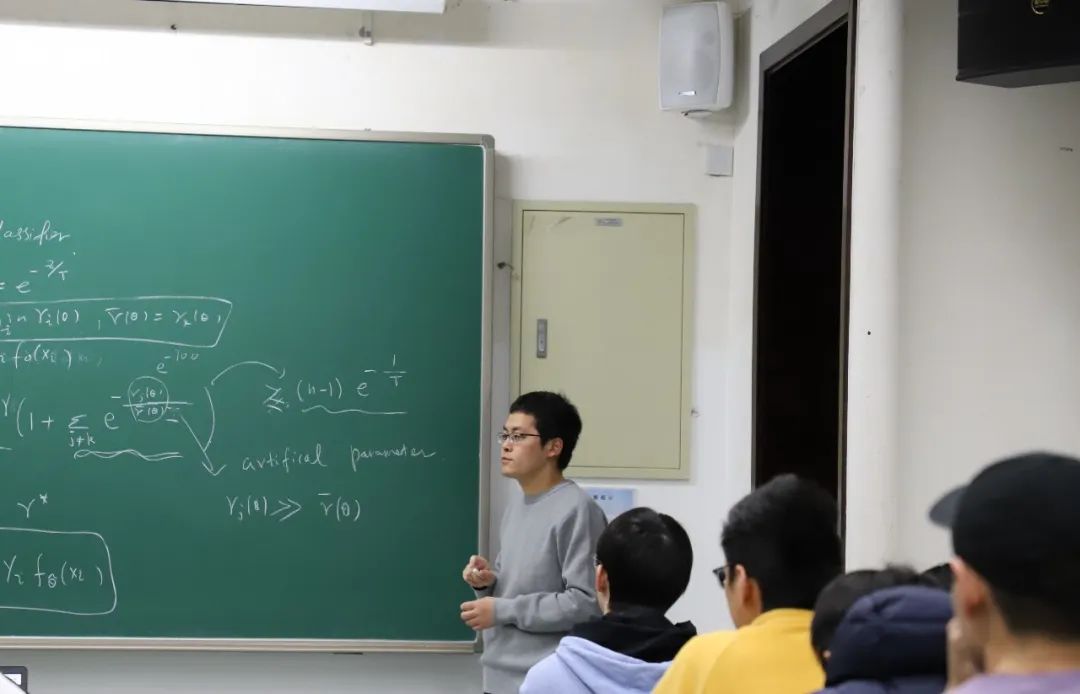

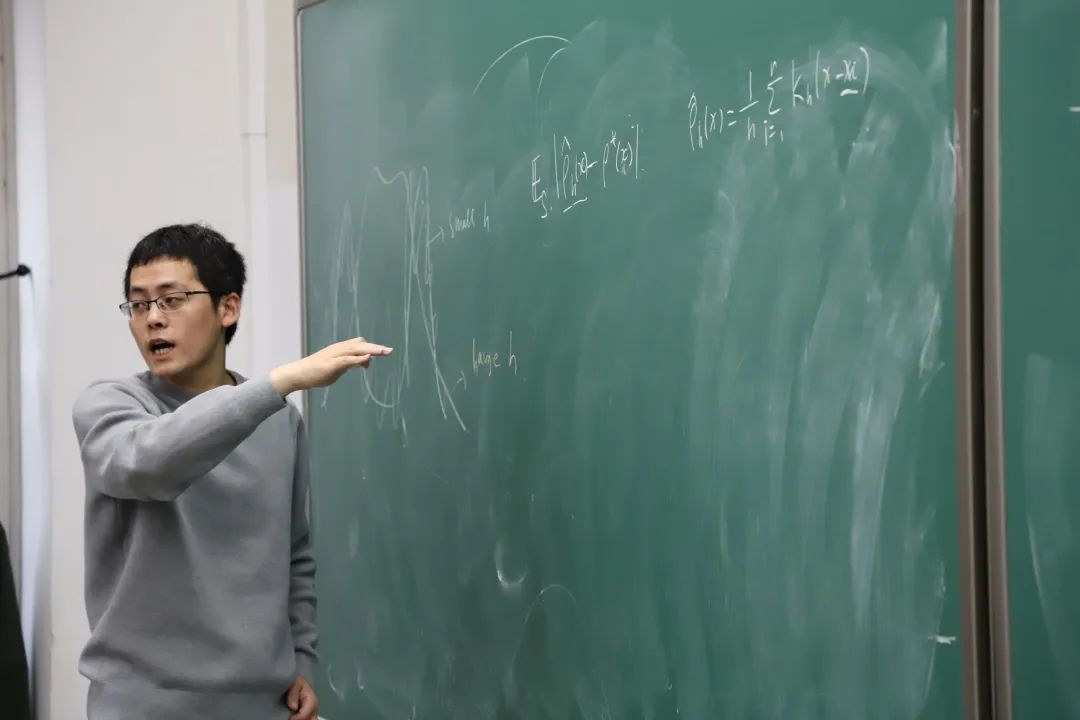

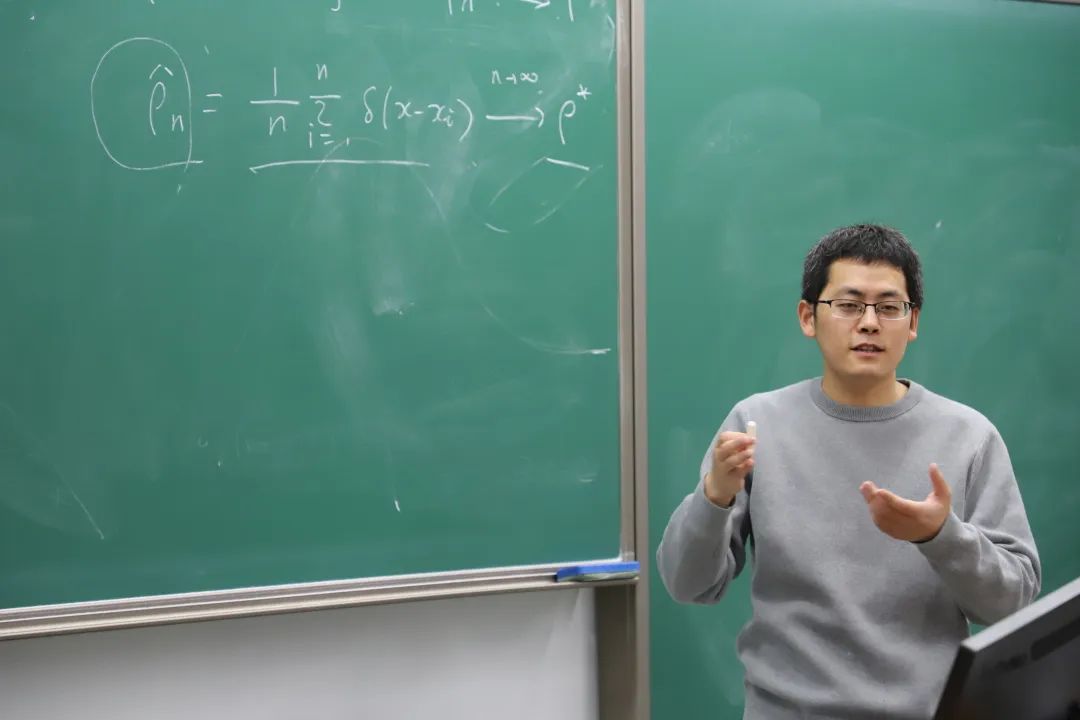

2022春吴磊老师在北大开设“数据科学导引”课程

Q:您已回来了一段时间,回来后有些什么特别的经历或是什么印象深刻的事情吗?

A:我这次回来印象最深刻的是北京的雾霾好像很少了。学校施工也少了很多,感觉北大可以摘掉“北京工地大学”的帽子了。(笑)

Q:对在这里的研究生涯,您有什么计划和期待?

A:我短期内计划把关于稳定性角度的隐式正则化方面的研究给逐步完善。长期来说,我希望最终能搞明白三个问题:神经网络模型到底是怎么工作的?神经网络模型的损失景观到底长什么样子?随机梯度法是怎么在没有任何先验指导下找到那些好解的?

我也期待能够和北大的老师和学生建立良好的合作,做出更好的工作。实际上,我最近有跟张磊老师讨论神经网络模型的能量景观,他基于计算物理背景的理解让我深受启发;希望能合作出一些特别有意义的结果。

Q:您对未来的教学及人才培养工作有什么目标或是展望?

A:教学方面,我这学期正在讲授“数据科学导引”这门课。市面上已经有很多关于机器学习和数据科学的教材。但是这些教材都是计算机背景的人写的,并不特别适合数学系的学生来学习。我正在和鄂维南老师以及Stephan Wojtowytsch合写一本适合数学背景学生的教材。我希望在教学的过程里面可以教学相长、不断改进,提升这门课以及这本教材的质量。

人才培养方面,我还在逐步探索自己的方式。北大这边的学生都是最优秀的,我期待他们以后能够做出最杰出的工作。

“数据科学导引”课堂

Q:立足当下,您对想要走上数学学术之路的学生们有什么建议?

A:保持好奇心,多问为什么。

Q:请您谈谈数学研究的苦与乐,在学习和研究数学的过程中您遇到过哪些困难,又是如何克服的?

A:深度学习的理论研究最吸引我的地方在于:需要自己做数值实验发现并凝练一些“神秘”的现象;然后需要设计“简化”的数值实验来构建对这些现象的直观理解;最后才是应用数学工具进行理论分析。可能很多数学工作者不喜欢做数值实验,但是我个人非常享受这个过程。就好像我喜欢爬山、徒步,你永远不知道接下来的风景什么,这种探索过程非常令人着迷。这种探索也让我感受到应用数学的魅力。

我印象比较深刻的就是我们关于随机梯度法在极小值点附近的逃离现象的研究。逃离现象本身没有特别奇怪的,但是我自己做了大量实验发现,这个逃离往往就发生在几个迭代步,而不是几千、上万步。我自己当时百思不得其解,于是找到鄂老师和马超讨论。结果马超构造了一个简单的一维例子,用稳定性角度给出了一个非常漂亮且简单的解释。在此基础上,我们发展了稳定性诱导的隐式正则化理论。这个经历对我影响极其深刻,让我意识到构造简单例子、设计简单数值实验在研究中的重要性。

Q:生活中的您有什么兴趣爱好吗?喜欢通过什么方式来为自己减压?

A:读博的时候特别喜欢刷经典电影,不过现在看得也比较少了。另外,我也喜欢徒步和爬山,读博期间把北京周边大大小小的山头爬了个遍,比如妙峰山、箭扣、灵山、海坨等。印象最深刻的是重装徒步小五台山那次。那天扎营在山脊上,冰雹、暴雨搞得一夜没怎么睡,总是担心帐篷撑不住。

结果惊喜总在意料之外:半夜雨停,云散,月出;云海从山谷里慢慢升起,在月光下美得让人窒息。

现在减压的方式就是每周跑两个5公里,没事来趟妙峰山。

五台山云海 吴磊摄